书生大模型实战营-L1-书生·浦语大模型全链路开源开放体系介绍

本文最后更新于:2024年9月30日 19:29

本节任务要点

- 了解书生·浦语大模型体系

介绍

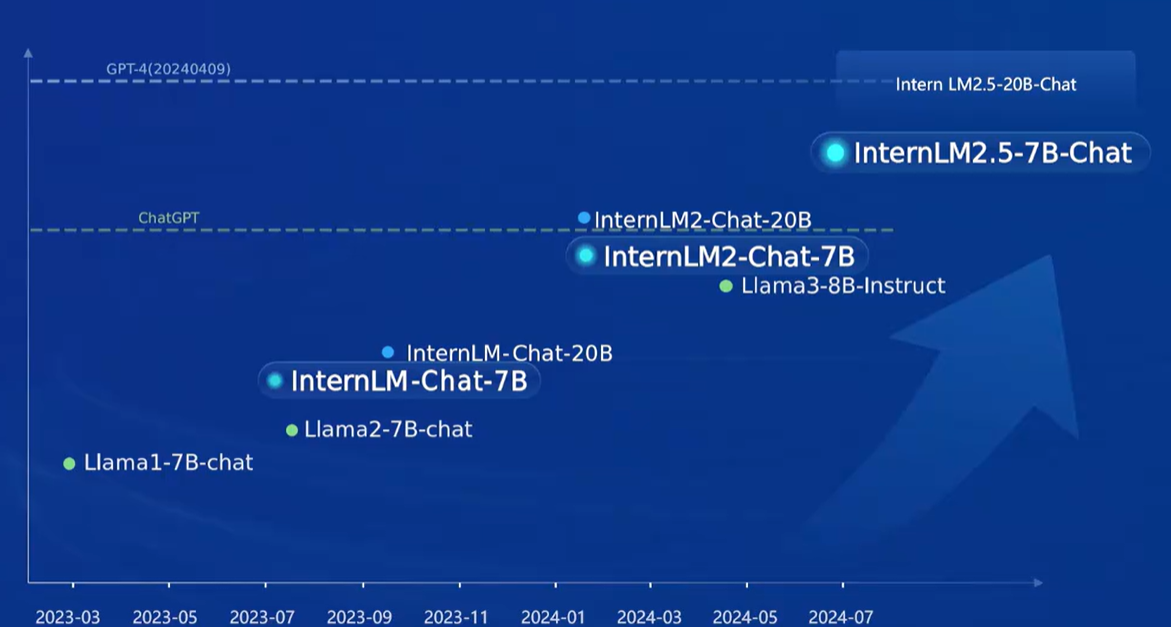

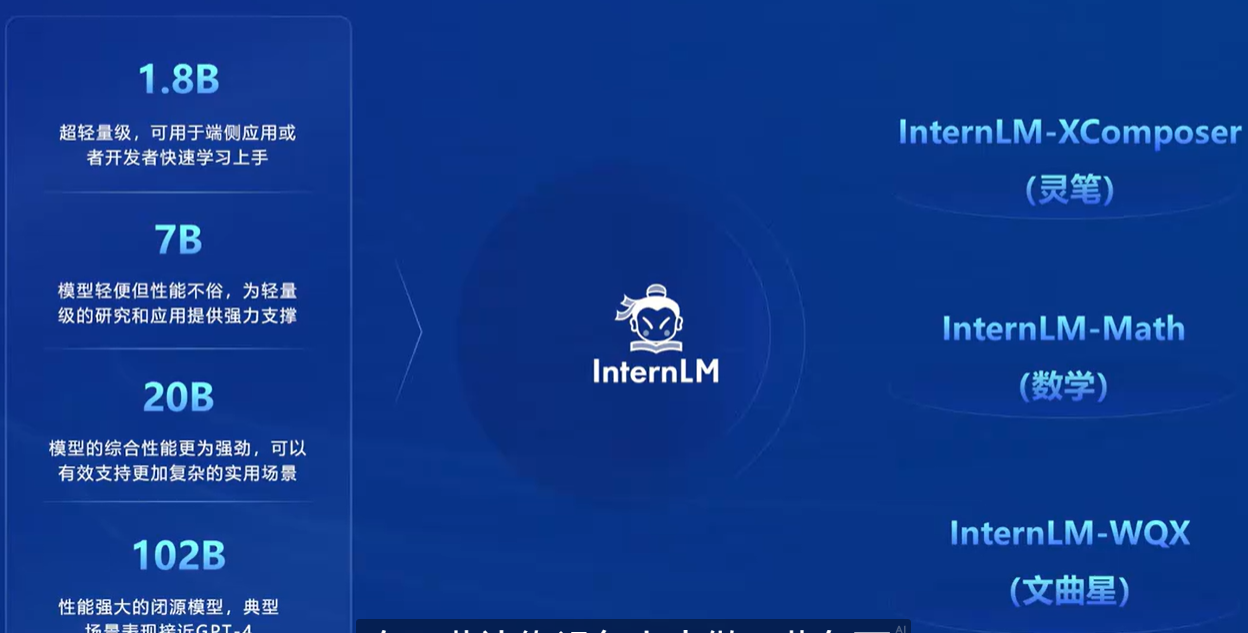

InternLM2.5 系列模型:

- 卓越的推理性能:在数学推理方面取得了同量级模型最优精度,超越了 Llama3 和 Gemma2-9B。

- 有效支持百万字超长上下文:模型在 1 百万字长输入中几乎完美地实现长文“大海捞针”,而且在 LongBench 等长文任务中的表现也达到开源模型中的领先水平。 可以通过 LMDeploy 尝试百万字超长上下文推理。更多内容和文档对话 demo 请查看这里。

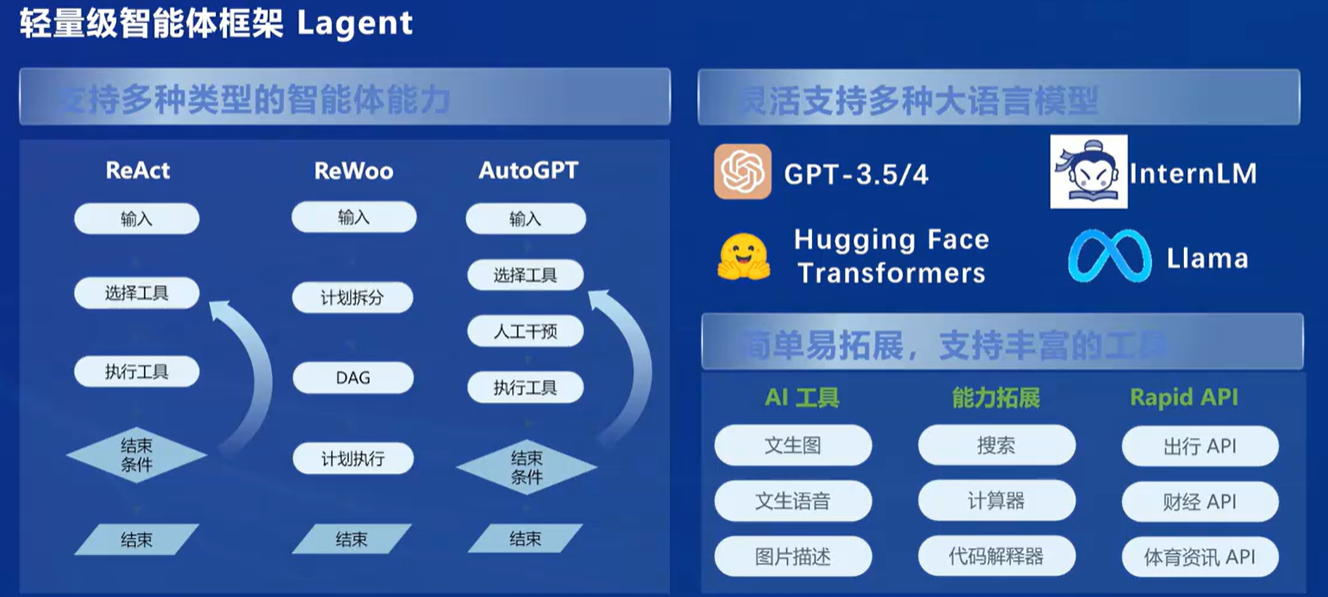

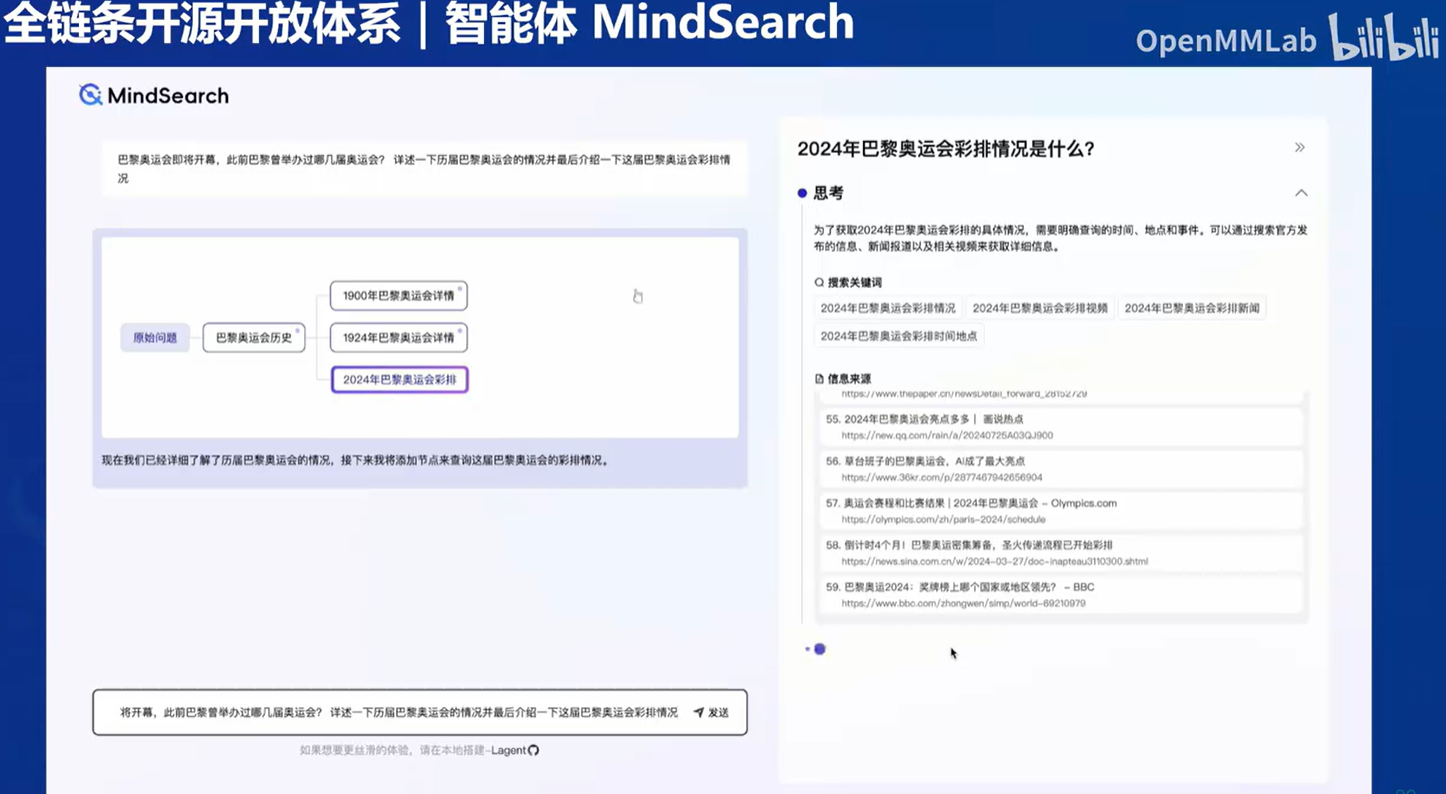

- 工具调用能力整体升级:InternLM2.5 支持从上百个网页搜集有效信息进行分析推理,相关实现将于近期开源到 Lagent。InternLM2.5 具有更强和更具有泛化性的指令理解、工具筛选与结果反思等能力,新版模型可以更可靠地支持复杂智能体的搭建,支持对工具进行有效的多轮调用,完成较复杂的任务。可以查看更多样例。

总结

书生大模型全链路开源体系通过全面开源,为全球开发者提供了强大的技术基础和支持,推动了人工智能技术的共享和创新。随着技术的不断进步和应用场景的不断拓展,书生大模型将在未来发挥更加重要的作用。

好东西!学!

书生大模型实战营-L1-书生·浦语大模型全链路开源开放体系介绍

https://junyaohu.github.io/2024/09/30/internlm-L1-intro/